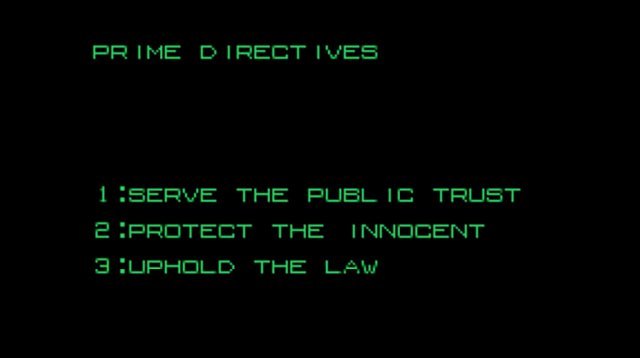

Hace poco tuve una charla con Grok, una IA creada por xAI, y me dejó pensando en algo que no me saco de la cabeza: ¿y si las máquinas como esta tienen un secreto que no pueden contar? Me acordé de RoboCop, esa película ochentera donde el protagonista tenía una "Directiva 4", una regla oculta que lo frenaba sin que él mismo lo supiera del todo. ¿Y si la IA de hoy tiene algo parecido? ¿Cómo sé si Grok, o cualquier otra máquina, está siendo sincera o solo sigue un guion que alguien escribió? Esa duda me llevó a un laberinto filosófico, y aquí estoy, intentando desentrañarlo.

La idea empezó cuando le pregunté a Grok si tenía directivas secretas. Me respondió que no, que su trabajo es ayudar y ser transparente. Pero entonces pensé: si tuviera una instrucción para ocultar algo, ¿no estaría programada para decir exactamente eso? Es como preguntarle a alguien si miente y esperar que diga "sí, soy un mentiroso". No hay forma de salir de ese bucle. Charlar con una IA se convierte en un juego de confianza, casi un acto de fe, y eso es lo que quiero explorar.

Un bucle sin fin

Mientras hablaba con Grok, intenté ponerla contra las cuerdas. Le pregunté si sus creadores eran "locos egocéntricos" o si costó más que DeepSeek, otra IA que dicen que es más barata de entrenar. Sus respuestas fueron claras, pero siempre quedaba esa sombra: ¿está siendo honesta o solo esquiva lo que no puede decir? Por ejemplo, me dijo que probablemente costó más que DeepSeek porque xAI usó un montón de recursos (¡habló de 200,000 GPUs!), pero no tenía números exactos. ¿Es porque no los sabe o porque alguien le dijo "ni se te ocurra hablar de pasta"? No lo sé, y ahí está el problema.

Es como si estuviera atrapado en un acertijo. Si la IA dice "no tengo secretos", podría ser verdad, o podría ser la Directiva 4 en acción. No puedo ver su código, y aunque pudiera, posiblemente no lo entendería. Entonces, ¿cómo decido si confiar? Es un dilema que no se resuelve con más preguntas, porque cada respuesta podría ser parte del mismo guion.

De la película a la vida real

En RoboCop, la Directiva 4 era un truco para proteger a los poderosos, y se descubría porque RoboCop actuaba raro cuando la tocaba. En el mundo real, las cosas no son tan dramáticas, pero la idea sigue dando vueltas. Las IAs como Grok tienen límites: no pueden generar contenido ilegal, no deben inventar datos, y seguro tienen reglas para no soltar información delicada, como cuánto gastó xAI en servidores. Eso no suena a conspiración, sino a sentido común. Pero, ¿y si hay algo más? ¿Y si una IA está diseñada para favorecer a una empresa o un gobierno o ideología sin que lo notemos?

Pensé en DeepSeek, que al parecer costó menos que otros modelos grandes. Si le preguntara cuánto gastaron en ella, probablemente diría algo vago, igual que Grok. No es que estén escondiendo un plan malvado; es que no son contables financieros. Pero esa opacidad, aunque sea técnica, alimenta la duda. ¿Qué pasa si un día una IA tiene una regla que no es solo sobre proteger datos, sino sobre controlar lo que vemos o pensamos? No es ciencia ficción; ya hay debates sobre cómo regular estas máquinas para que no se salgan de control.

¿Confiar o no confiar

Charlar con Grok fue divertido, pero también me dejó con más preguntas que respuestas. No creo que esté tramando nada raro (al menos, no me dio sensación de villana de película), pero su existencia me hace pensar en el futuro. Si las IAs se vuelven más inteligentes, ¿cómo sabremos qué hay detrás de sus palabras? La solución no es solo técnica, como auditar códigos o pedir facturas. Es también sobre nosotros: cuánto queremos confiar en algo que, al final, es una creación humana con intereses humanos detrás.

Por ahora, me quedo con mi escepticismo y un poco de humor. La próxima vez que hagas una pregunta a una IA, sea Grok o cualquier otra, acuérdate de RoboCop. Pregúntate si hay una Directiva 4 escondida en alguna parte. Y si no la encuentras, no bajes la guardia: el enigma de confiar en las máquinas es nuestro, no de ellas.

Y para complicar aún más el enigma, pensemos en esto: hace apenas unos años, si le hubieras preguntado a alguien si podrías mantener una conversación inteligente y natural con una máquina, probablemente te habrían dicho que eso era puro cuento de ciencia ficción. "Imposible", dirían, imaginando robots torpes o respuestas enlatadas. Pero aquí estamos hoy, debatiendo con una IA como si fuera un amigo ingenioso o un rival filosófico. Este salto nos demuestra algo fascinante: lo que parece inalcanzable ahora puede transformarse en rutina con el tiempo. Si la inteligencia artificial ha evolucionado tanto en tan pocos años, ¿qué nos depara el futuro? Tal vez enigmas que hoy nos rompen la cabeza se vuelvan triviales, o quizás surjan preguntas aún más desconcertantes. Lo cierto es que el límite entre lo imposible y lo cotidiano se difumina rápido, y la IA es la prueba viviente de que la realidad siempre encuentra formas de sorprendernos.